Quelques semaines après le lancement de Gemini 3, et quelques jours après celui de serveurs MCP managés pour ses outils, Google poursuit son offensive dans l’IA agentique. Ce 11 décembre 2025, le géant de Mountain View a dévoilé l’API Interactions, une nouvelle interface destinée aux développeurs, ainsi qu’une version réimaginée de son agent de recherche Deep Research.

Ces annonces interviennent le même jour que le lancement de GPT-5.2 par OpenAI, illustrant l’intensité de la course technologique entre les deux entreprises. Cette double sortie marque un tournant : Google ne se contente plus de proposer des modèles de langage, mais ouvre plus largement l’accès à des systèmes agentiques complets capables d’exécuter des tâches complexes de manière autonome.

L’API Interactions constitue une évolution majeure de l’écosystème Gemini. Contrairement à l’API generateContent, initialement conçue par Google pour des échanges ponctuels de génération de texte, l’API Interactions introduit un endpoint unique capable de gérer à la fois des appels directs aux modèles Gemini et des interactions avec des agents autonomes comme Deep Research (voir plus bas). Cette approche unifiée simplifie l’architecture pour les développeurs et développeuses, qui peuvent désormais basculer entre un modèle classique et un agent complexe sans changer d’infrastructure.

L’architecture intègre nativement la gestion d’état côté serveur, l’exécution en arrière-plan pour les tâches longues, et un schéma de données optimisé pour gérer l’entrelacement de messages, raisonnements, appels d’outils et leurs résultats. Google a également intégré le support direct des serveurs MCP (Model Context Protocol), permettant aux modèles d’appeler des outils externes de manière transparente.

Disponible en bêta publique via Google AI Studio, l’API Interactions vise à simplifier le développement d’applications agentiques en déléguant au serveur la complexité de la gestion du contexte. Google annonce que l’Agent Development Kit (ADK) et le protocole Agent2Agent (A2A) supportent déjà cette nouvelle API, avec un déploiement prévu prochainement sur Vertex AI pour les clients entreprises. L’objectif affiché est de permettre aux développeurs et développeuses de connecter modèles Gemini, agents natifs de Google et agents personnalisés via une interface unique, posant les bases d’un écosystème agentique interopérable.

Gemini Deep Research fait également peau neuve avec cette annonce. Propulsé par Gemini 3 Pro, qualifié par Google de modèle « le plus factuel » de sa gamme, cet agent autonome est spécifiquement entraîné pour réduire les hallucinations lors de tâches de recherche complexes. Il fonctionne de manière itérative : formulation de requêtes, analyse des résultats, identification des lacunes et nouvelles recherches.

Cette version doit également améliorer considérablement les capacités de navigation web, permettant d’explorer en profondeur les sites pour extraire des données spécifiques. L’agent peut désormais analyser simultanément des documents personnels (PDF, CSV, docs) et des données web publiques, avant de synthétiser l’ensemble en rapports structurés avec des citations dites « granulaires ».

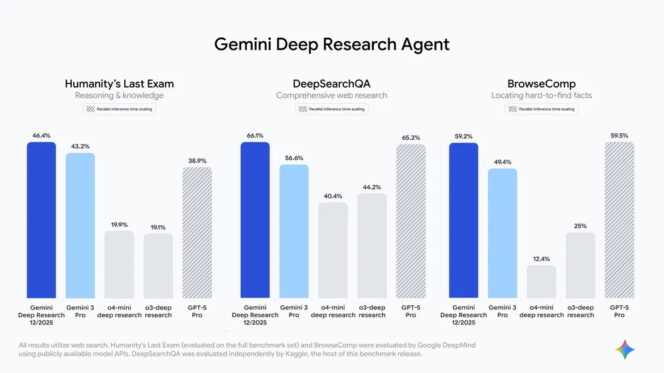

Pour la première fois, les développeurs et développeuses peuvent intégrer ces capacités de recherche avancées directement dans leurs applications avec l’API Interactions. Google prévoit d’intégrer prochainement cette version de Deep Research dans Google Search, Google Finance, l’application Gemini et NotebookLM. Pour démontrer ses avancées, Google a publié DeepSearchQA, un nouveau benchmark de 900 tâches évaluant les agents sur des recherches multi-étapes complexes, sur lequel Deep Research obtient un score de 66,1 %.

Integer iaculis ultrices velit nec tempor. Pellentesque aliquet est massa, sit amet tempor mi auctor nec. Mauris a nibh sed libero fermentum aliquet. Quisque sit amet faucibus magna. Do purus mi, commodo id commodo vel, im perdiet ut mauris. Ut ultricies arcu risus, males uada efficitur orci euismod in. Proin ele est risus, ac sodales nulla mollis vel. .

Lorem ipsum dolor sit amet, consetetur sadipscing elitr, sed diam nonumy eirmod tempor invidunt ut labore et dolore magna aliquyam erat.

In nec libero luctus, aliquet turpis at, vehicula nisi. Cras eget mauris in nisl tempus lobortis.

Neque porro quisquam est, qui is dolor emr ipsum quia dolor sit amet the consec tetur is adipisci velit, sed Neque porro.